En el ámbito de la termodinámica, la entropía, simbolizada como S, es una magnitud física fundamental que describe el estado de un sistema termodinámico en equilibrio. Como función de estado de carácter extensivo, su valor en un sistema aislado tiende a crecer en el transcurso de los procesos naturales, siendo un indicador clave de la irreversibilidad de dichos sistemas.

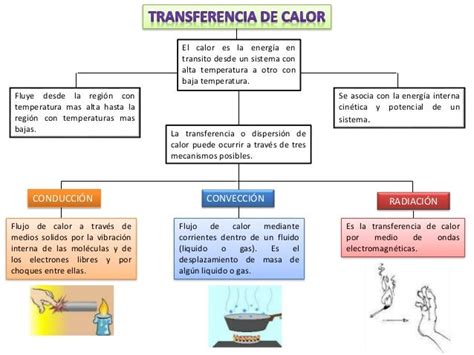

El término "entropía" proviene del griego (ἐντροπία) y evoca las ideas de evolución o transformación. La pregunta fundamental sobre por qué los sucesos en la naturaleza se desarrollan de una manera determinada y no de otra encuentra su respuesta en el concepto de entropía, que dicta el sentido de estos procesos. Un ejemplo clásico es el contacto entre dos trozos de metal a distinta temperatura: se espera que el más caliente se enfríe y el más frío se caliente hasta alcanzar el equilibrio térmico. El proceso inverso, donde el trozo caliente se calienta aún más y el frío se enfría, es altamente improbable, a pesar de conservar la energía total. El universo, en su conjunto, tiende a distribuir la energía de manera uniforme, es decir, a maximizar la entropía.

La función termodinámica de la entropía es central para el segundo principio de la termodinámica. Puede interpretarse como una medida de la distribución aleatoria de un sistema: un sistema con una alta distribución aleatoria posee alta entropía. Ante una condición improbable, un sistema tenderá naturalmente a reorganizarse hacia una condición más probable, similar a una distribución aleatoria, lo que resultará en un aumento de la entropía.

La Entropía como Función de Estado y Medida del Desorden Molecular

Una magnitud se considera una función de estado si su cambio de valor entre dos estados es independiente del proceso seguido para alcanzar dichos estados. La variación de entropía, en este contexto, revela la variación del orden molecular en una reacción química. Un incremento positivo de entropía indica que los productos presentan un mayor desorden molecular (mayor entropía) en comparación con los reactivos. Por el contrario, un incremento negativo sugiere que los productos son más ordenados.

Dentro de la termodinámica, la entropía se concibe como una medida del desorden de un sistema sistematizado, indicando que aquello que no es controlado puede transformarse y desordenarse. Esta noción de desorden termodinámico fue formalizada por Rudolf Clausius a través de una función ideada para procesos cíclicos reversibles. La variación de entropía (ΔS) se define como la integral de la cantidad de calor (δQ) absorbida en un proceso dividida por la temperatura absoluta (T) a la que ocurre este proceso: ΔS = ∫(δQ/T).

Es crucial entender que el calor (Q) no es una función de estado, por lo que se utiliza la notación δQ. Si el calor se transfiere al sistema, la entropía también lo hará en la misma dirección. En el caso de un sistema que interactúa con múltiples fuentes de calor, la variación total de entropía se expresa como la suma de las variaciones debidas a cada fuente: ΔS = Σ(δQᵢ/Tᵢ).

El término Σ(δQᵢ/Tᵢ), siempre positivo, se denomina producción de entropía. Este término es nulo cuando el proceso es reversible, salvo por las irreversibilidades inherentes a las transferencias de calor con fuentes externas al sistema. Solo es posible calcular variaciones de entropía; para determinar la entropía absoluta de un sistema, es necesario fijar su valor en un estado de referencia determinado.

El Segundo Principio de la Termodinámica y la Dirección de los Procesos Naturales

La entropía permite definir el segundo principio de la termodinámica, del cual se deduce que un proceso tiende a ocurrir espontáneamente en un único sentido. La entropía global del universo, entendida como la suma de la entropía del sistema y la de sus alrededores, tiene una tendencia general al aumento. En un proceso reversible ideal, la variación de entropía del universo es cero (ΔS(universo) = 0). Sin embargo, esta es una situación teórica, ya que los procesos reales son siempre irreversibles y, por lo tanto, conllevan un aumento de la entropía.

A diferencia de la energía, que no puede crearse ni destruirse, la entropía puede crearse, pero no destruirse. Esto implica que la entropía del universo crece constantemente. La "muerte térmica del universo", enunciada por Clausius, ocurriría cuando la entropía alcance su valor máximo, momento en el cual existiría un equilibrio térmico y de presiones en todo el universo, cesando todo proceso físico.

Es importante señalar que el segundo principio de la termodinámica no es aplicable a microsistemas, cuyas dimensiones son comparables a las de las moléculas. En estos casos, la distinción entre calor y trabajo se desvanece, y parámetros como la entropía y la temperatura pierden su significado.

Historia del Concepto de Entropía

El concepto de entropía surgió como respuesta a la observación de que una parte de la energía liberada en reacciones de combustión se perdía por disipación o fricción, sin transformarse en trabajo útil. Los primeros motores de calor, como el de Thomas Savery (1698) y la máquina de Newcomen (1712), eran notablemente ineficientes, convirtiendo menos del 2% de la energía de entrada en trabajo útil, con una gran cantidad de energía disipada en lo que se percibía como un estado de aleatoriedad inconmensurable.

En la década de 1850, Rudolf Clausius estableció el concepto de sistema termodinámico y postuló que, en cualquier proceso irreversible, una pequeña cantidad de energía térmica (δQ) se disipa gradualmente a través de la frontera del sistema. Clausius acuñó el término "entropía" para describir esta energía perdida. Durante el siglo siguiente, el concepto fue desarrollado por otros científicos.

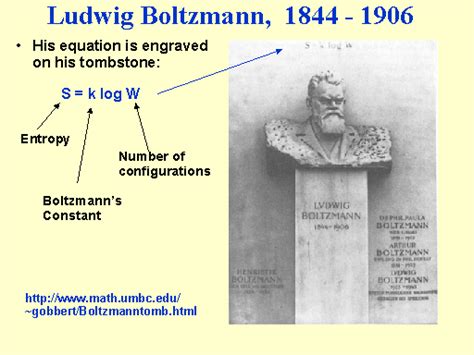

Entre 1890 y 1900, el físico austríaco Ludwig Boltzmann y sus colaboradores desarrollaron la física estadística, teoría profundamente influenciada por el concepto de entropía. Boltzmann formuló la famosa ecuación que relaciona la entropía (S) con el número de microestados posibles (Ω) de un sistema: S = k log Ω, donde k es la constante de Boltzmann. Esta ecuación, grabada en la tumba de Boltzmann en Viena, permitió dar una definición absoluta al concepto de entropía, a diferencia de la definición clásica que solo consideraba las variaciones de entropía.

Interpretaciones y Aplicaciones de la Entropía

La entropía ha dado lugar a diversas interpretaciones, a menudo aparentemente contradictorias, siendo asimilada sucesivamente a conceptos como el desorden y la información. La entropía mide tanto la falta de información como, inversamente, la información misma, concepciones que son complementarias. También se interpreta como una medida de la libertad de movimiento de las moléculas, lo que permite una interpretación coherente de las fórmulas y los hechos experimentales. Asociar entropía y desorden implica definir el orden como la ausencia de libertad de movimiento. El desorden o la agitación están relacionados con la temperatura: un aumento de la temperatura implica un mayor estado de energía de las moléculas, lo que conduce a un incremento de su movimiento y, consecuentemente, de la aleatoriedad de su posición y velocidad.

Coloquialmente, la entropía se asocia con el desorden de un sistema o su grado de homogeneidad. El ejemplo de un vaso de cristal que, al caer, se rompe en innumerables fragmentos, ilustra la tendencia hacia el desorden. Jamás se observará que fragmentos de cristal se junten espontáneamente para formar un vaso. Otro ejemplo doméstico es la mezcla de pintura blanca y negra: una vez mezcladas hasta obtener un gris homogéneo, es imposible separarlas para recuperar los colores originales. La entropía del conjunto aumenta hasta alcanzar un máximo cuando los colores son iguales.

La homogeneidad y la consiguiente pérdida de orden estructural pueden considerarse indicadores de entropía. El surgimiento de la vida, con su alta organización y concentración de elementos, supondría una disminución local de la entropía, en aparente contradicción con la Segunda Ley de la Termodinámica. Sin embargo, esta aparente contradicción se resuelve al considerar que la vida es un sistema abierto que importa energía y materia del entorno, aumentando la entropía total del universo. La producción de entropía, según Ilya Prigogine, contiene elementos creadores de desorden y de orden, que están intrínsecamente ligados.

Recientes estudios han establecido una relación entre la entropía física y la entropía de la teoría de la información, especialmente a través de la física de los agujeros negros. La teoría de Jacob Bekenstein postula que un bit de información sería equivalente a una superficie de valor 1/4 del área de Planck, y los agujeros negros almacenarían la entropía de los objetos que engullen en la superficie de su horizonte de sucesos.

La entropía no solo es un concepto central en termodinámica, sino que también tiene aplicaciones significativas en biología, teoría de la información y astrofísica.

Procesos Reversibles e Irreversibles y el Cálculo de la Entropía

En un ciclo reversible, la variación neta de entropía es cero. La entropía es una función de estado, lo que significa que depende únicamente del estado del sistema, no del camino seguido para alcanzarlo. Sin embargo, en procesos reales, el cambio de entropía siempre se incrementa.

Consideremos la variación de entropía (ΔS) para un sistema que experimenta un proceso reversible a temperatura constante (T). Si el sistema absorbe calor (Q > 0), su entropía aumenta: ΔS = Q/T. Por ejemplo, un gas a 300 K que absorbe 10 J de calor en un proceso reversible experimenta un aumento de entropía de 10 J / 300 K = 0.033 J/K.

Durante un cambio de fase, como la fusión del hielo en agua a 0°C (273 K), la temperatura se mantiene constante. Para un proceso reversible, el cambio de entropía se puede calcular utilizando la fórmula ΔS = Q/T, donde Q es el calor latente absorbido. Si se derrite 50 g de hielo, y el calor latente de fusión es 334 J/g, el calor absorbido es Q = 50 g * 334 J/g = 16700 J. El cambio de entropía sería ΔS = 16700 J / 273 K ≈ 61.2 J/K.

Para transiciones arbitrarias y reversibles donde la temperatura no es constante, la variación de entropía se define mediante una integral: ΔS = ∫(dQ/T). Si el sistema pasa por pequeños y discretos pasos, intercambiando calor ΔQᵢ de forma reversible a una temperatura Tᵢ, el cambio de entropía para cada paso es ΔSᵢ = Qᵢ/Tᵢ. Al tomar el límite cuando ΔQᵢ → 0 y el número de pasos tiende al infinito, se obtiene la integral:

ΔS = ∫AB (dQ/T)

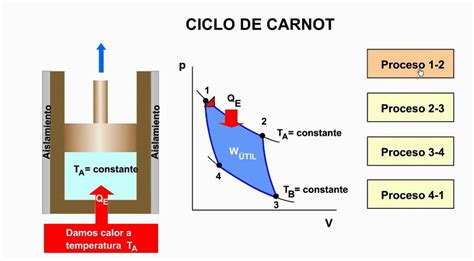

En un ciclo de Carnot reversible, la variación neta de entropía es cero. Las etapas adiabáticas no implican intercambio de calor (ΔS=0). En la etapa de absorción de calor (Qh a Th), el cambio de entropía es ΔS₁ = Qh/Th. En la etapa de liberación de calor (Qc a Tc), el cambio de entropía es ΔS₃ = -Qc/Tc. Para un ciclo completo reversible, la suma de estos cambios es cero.

La independencia del camino para el cambio de entropía en procesos reversibles se puede demostrar gráficamente. Si consideramos dos estados A y B, y dos caminos reversibles I y II que los unen, la integral de dS a lo largo de un ciclo cerrado es cero (∮dS = 0). Esto implica que la integral de A a B a lo largo de I es igual a la integral de A a B a lo largo de II, demostrando que el cambio de entropía es independiente del camino.

Procesos Irreversibles y el Aumento de Entropía

Cuando un proceso es irreversible, la entropía de un sistema cerrado, o del sistema y su ambiente (el universo), aumenta. La Segunda Ley de la Termodinámica establece que:

ΔS ≥ ∫(dQ/T)

donde el signo igual es para un proceso reversible y el signo menor que para uno irreversible. Para calcular el cambio de entropía en un proceso irreversible, no se puede usar directamente el calor intercambiado en el proceso real. Sin embargo, como la entropía es una función de estado, se puede imaginar un proceso reversible hipotético que conecte los mismos estados inicial y final para calcular el cambio de entropía.

Por ejemplo, al enfriar rápidamente un objeto caliente, podemos imaginar un proceso reversible donde el objeto entra en contacto térmico con reservorios de calor sucesivamente más fríos, desde su temperatura inicial (Th) hasta la temperatura final (Tc). En este caso, el objeto pierde entropía (ΔS < 0), pero el aumento de entropía de los alrededores compensa o supera esta pérdida, resultando en un aumento neto de la entropía del universo.

Ejemplos de Cálculo de Entropía

- Expansión de un gas: Si un gas se expande libremente hasta ocupar todo el volumen disponible, sus partículas se mueven de forma más aleatoria, aumentando la entropía.

- Cambios de estado: Al pasar de sólido a líquido o de líquido a gas, la entropía aumenta bruscamente debido a la mayor libertad de movimiento de las partículas.

- Formación de disoluciones: La formación de una disolución generalmente afecta a la entropía, aunque no siempre resulta en un aumento. Disolver un gas en un líquido, por ejemplo, puede disminuir la entropía.

- Motores térmicos: El estudio de la entropía es fundamental para comprender la eficiencia de las máquinas térmicas, como el motor de Stirling, que utiliza aire comprimido y un regenerador para mejorar la eficiencia.

En el caso de un gas monoatómico, el cambio de entropía durante un proceso isocórico (volumen constante) se calcula como ΔS = (3/2)nR ln(T₂/T₁), donde n es el número de moles, R la constante de los gases ideales, y T₁ y T₂ son las temperaturas inicial y final.

La capacidad calorífica (CV o CP) es crucial para calcular los cambios de entropía. Dado que la capacidad calorífica es siempre positiva, la entropía aumenta a medida que aumenta la temperatura. La energía interna (U) y la entalpía (H) pueden expresarse en función de variables como la entropía y el volumen (U(S,V)) o la entropía y la presión (H(S,P)), permitiendo derivar expresiones para el cambio de entropía.